IA symbolique et IA générative : pourquoi les opposer est une erreur et comment les combiner

Depuis 2022, les LLM ont tout éclairé sur leur passage. ChatGPT, Claude, Gemini : ces modèles capables de rédiger, résumer, traduire et coder ont fait passer l’IA générative du labo au quotidien professionnel en moins de deux ans. Et dans leur sillage, un discours s’est imposé : l’IA « moderne » (générative, statistique, connexionniste) aurait définitivement remplacé l’IA « classique » (symbolique, basée sur des règles, des ontologies, des graphes de connaissances).

C’est un contresens. Pas juste une simplification : un vrai contresens, qui conduit des organisations à déployer des IA génératives sur leur base documentaire interne et à s’étonner ensuite que le système hallucine, invente des chiffres, confonde des dates ou ignore des contraintes métier pourtant explicites.

La réalité de 2026 ? Les architectures IA les plus robustes en production combinent les deux approches. Ce n’est pas un compromis entre deux demi-solutions : c’est la convergence de deux forces complémentaires. Voici pourquoi, et surtout comment.

En bref, l’IA symbolique apporte la précision, la traçabilité et le raisonnement logique. L’IA générative apporte la fluidité, la compréhension du langage naturel et la créativité. Ensemble, elles forment une architecture IA à la fois intelligible et puissante, ce que ni l’une ni l’autre ne peut atteindre seule.

Qu’est-ce que l’IA symbolique, exactement ?

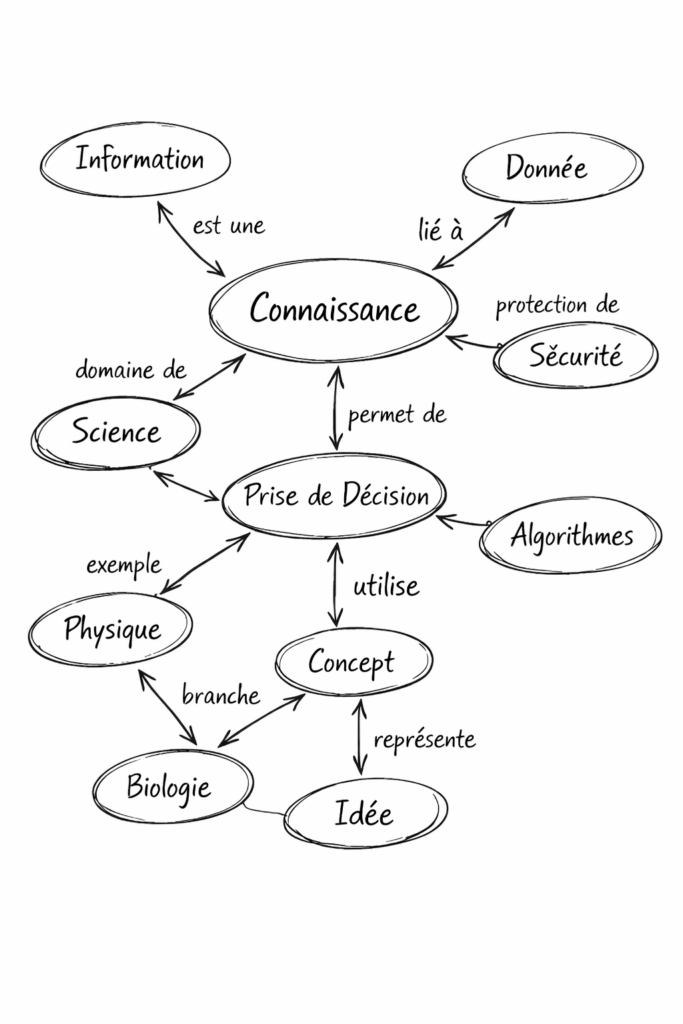

L’IA symbolique est la branche de l’intelligence artificielle qui représente la connaissance sous forme de symboles logiques (des concepts, des relations, des règles) que les machines peuvent manipuler de façon explicite et vérifiable. On parle aussi d’IA basée sur la connaissance, ou de Knowledge-Based AI.

Ses outils canoniques sont bien connus dans le monde de l’ingénierie des connaissances : les ontologies OWL (Web Ontology Language), les graphes de connaissances (knowledge graphs), les bases de règles (SWRL, RIF), les triplestores et le langage de requête SPARQL. Une ontologie OWL décrit, dans un formalisme logique, les concepts d’un domaine et les relations qui les unissent permettant à une machine non seulement de stocker de l’information, mais de raisonner dessus.

Ce qu’une ontologie sait faire qu’un LLM ne peut pas

Une ontologie peut inférer. Si vous définissez qu’un « médicament » appartient à la classe « substance active » et que toute substance active doit avoir une autorisation de mise sur le marché (AMM), alors tout système de raisonnement OWL saura automatiquement appliquer cette contrainte à chaque médicament ajouté à la base, même si on ne le lui a jamais dit explicitement pour ce médicament précis.

Un LLM, lui, ne raisonne pas. Il prédit. Il génère le prochain token le plus probable en fonction de ce qu’il a vu pendant son entraînement. C’est formidablement utile et radicalement différent d’un raisonnement logique vérifiable.

L’IA générative : une puissance réelle, des failles documentées

Inutile de développer longuement ce que font les LLM : tout le monde en a désormais une idée. Ce qui mérite d’être dit, en revanche, c’est ce qu’ils ne font pas bien et ce malgré les améliorations continues des modèles.

| Force des LLM | Limite documentée |

|---|---|

| Compréhension du langage naturel | Hallucinations factuelles (inventer des sources, des chiffres, des noms) |

| Génération de texte fluide et contextualisée | Absence de mémoire long terme sans RAG |

| Polyvalence inter-domaines | Incapacité à raisonner selon des règles métier explicites |

| Résumé et synthèse documentaire | Opacité totale (« boîte noire » — pas de traçabilité) |

| Adaptation au ton et au contexte | Connaissances figées à la date d’entraînement |

Ces limites ne sont pas des bugs qu’un prochain modèle corrigera. Elles sont structurelles : elles tiennent à la nature même de l’apprentissage statistique. Un modèle qui prédit des tokens à partir de patterns ne peut pas, par construction, garantir la vérité factuelle d’une assertion, ni appliquer une règle métier qu’il n’a pas « vue » pendant son entraînement.

« Un LLM n’a pas de modèle du monde. Il a un modèle du langage sur le monde. La nuance est énorme dès que l’enjeu dépasse la rédaction de mails. »

Pourquoi la combinaison est la réponse et non le compromis

La question ne devrait pas être « IA symbolique ou IA générative ? » mais « à quel endroit de mon architecture chaque approche est-elle la plus efficace ? ».

L’IA symbolique excelle là où il faut de la précision, de la traçabilité et du raisonnement logique : structurer les connaissances métier, définir des règles, vérifier des contraintes, inférer des relations implicites. L’IA générative excelle là où il faut de la fluidité, de la compréhension contextuelle et de la génération : interpréter une question en langage naturel, rédiger une réponse compréhensible, s’adapter au ton de l’interlocuteur.

Ces deux espaces ne se chevauchent que partiellement. Et c’est précisément ce qui rend leur combinaison si puissante : ils se complètent sans se cannibaler.

RAG + knowledge graph : l’architecture hybride de référence en 2026

Le RAG (Retrieval-Augmented Generation) est déjà bien connu : plutôt que de s’appuyer uniquement sur les connaissances figées du LLM, on lui fournit à chaque requête des documents pertinents récupérés dans une base externe. Le modèle « augmente » sa génération avec de l’information fraîche et spécifique.

Le RAG classique utilise une base vectorielle (embeddings sémantiques). C’est utile mais limité. Les vecteurs capturent la proximité sémantique entre textes, pas les relations logiques entre concepts. Ils ne savent pas qu’un médicament appartient à une classe thérapeutique, qu’un contrat engage deux parties, ou qu’une règle métier s’applique à tous les éléments d’une catégorie.

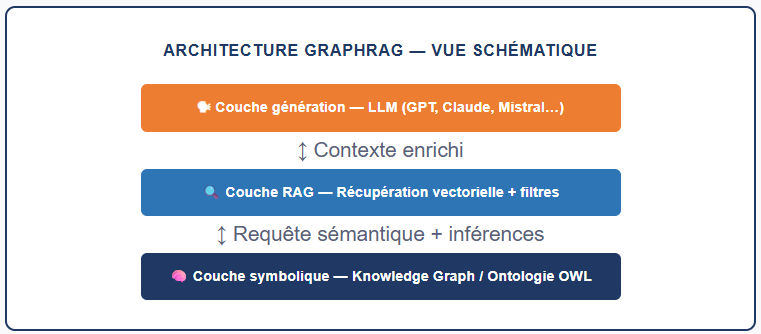

GraphRAG : quand le knowledge graph entre dans la boucle

GraphRAG est l’évolution naturelle : au lieu d’une (ou en complément d’une) base vectorielle, on utilise un graphe de connaissances structuré, idéalement formalisé en OWL, comme couche de récupération. Quand l’utilisateur pose une question, le système ne cherche plus seulement des documents « proches » : il raisonne sur les relations entre entités, remonte des inférences, applique les règles du domaine, puis transmet cette connaissance structurée au LLM pour génération.

Le résultat ? Des réponses qui combinent la fluidité du langage naturel avec la précision d’un raisonnement structuré. Zéro hallucination sur les faits modélisés dans le graphe. Traçabilité complète des sources. Respect automatique des contraintes métier encodées dans l’ontologie.

Un exemple concret : la pharmacovigilance

Imaginez un système IA déployé dans un département de pharmacovigilance. L’équipe veut pouvoir poser des questions en langage naturel sur les données de l’Agence Nationale de Sécurité du Médicament : « Quels médicaments à base de principes actifs X et Y ont une interaction documentée avec la classe Z ? »

Avec un LLM seul : risque d’hallucination élevé sur des données aussi critiques. Impossible à certifier. Refus probable des équipes réglementaires.

Avec une ontologie OWL des médicaments (les 14 000 concepts de l’ANSM, formalisés et raisonnés) alimentant un GraphRAG : la requête traverse d’abord le graphe de connaissances, récupère les entités pertinentes et leurs relations validées, puis soumet ce contexte précis au LLM pour une réponse en français clair, sourcée et vérifiable. La productivité des experts est multipliée. La fiabilité est garantie par la couche symbolique.

Ce que ça change concrètement pour votre organisation

La combinaison IA symbolique + IA générative ne s’adresse pas uniquement aux équipes data. Elle concerne toute organisation qui veut déployer l’IA sur ses connaissances propriétaires — documentation technique, base de règles métier, référentiels réglementaires, mémoire organisationnelle.

-

- DSI et architectes SI : GraphRAG est une architecture de production, pas une POC. Elle s’intègre dans les stacks existantes (Elasticsearch, Neptune, Stardog, Jena…).

-

- Chefs de projet IA : le knowledge graph est le périmètre de confiance que votre LLM ne franchira pas. C’est la réponse aux objections de la DPO, du service juridique et des métiers.

-

- Data scientists : l’ontologie OWL n’est pas un frein à l’agilité, c’est le contrat sémantique qui rend vos pipelines réutilisables et interopérables.

-

- Directions métier : un assistant IA capable de répondre en langage naturel tout en respectant vos règles métier explicites, c’est la différence entre un chatbot gadget et un outil de productivité sérieux.

Par où commencer ? Trois points d’entrée pratiques

Pas besoin de tout refaire.

L’intégration IA symbolique + générative peut se faire de façon incrémentale :

Auditer vos connaissances métier existantes. Quelles sont vos règles, vos taxonomies, vos référentiels ? Sont-ils modélisés formellement ou éparpillés en Word, Excel, wikis ? Un audit de connaissance est le préalable à toute ontologie.

Commencer par un domaine restreint et bien défini. Une ontologie de 200 concepts bien structurée est plus utile qu’un graphe de 10 000 concepts mal alignés. L’approche modulaire est la bonne méthode.

Connecter progressivement à votre couche RAG. La plupart des frameworks LLM modernes (LangChain, LlamaIndex, Haystack) supportent l’intégration de graphes RDF/OWL. Le chemin technique est balisé.

Ce qui manque le plus souvent, ce n’est pas la technologie. C’est la méthode, l’ingénierie des connaissances, et l’expertise pour modéliser correctement ce que votre organisation sait vraiment.

FAQ

Non, et les recherches récentes le confirment. Les LLM peinent sur les tâches qui nécessitent un raisonnement multi-étapes précis, une traçabilité ou le respect de contraintes logiques strictes. L’IA symbolique reste irremplaçable sur ces aspects. C’est pour ça que les architectures hybrides (GraphRAG, neuro-symbolique) dominent la recherche appliquée en 2026.

Pas nécessairement. Des outils comme Protégé (interface graphique) permettent de construire et visualiser des ontologies sans écrire de code. La complexité technique augmente avec la taille de l’ontologie et son intégration dans un système plus large. Les formations Cogsonomy s’adressent à des profils variés, de l’architecte SI au chef de projet, en passant par le data scientist.

Une ontologie définit le modèle, les classes, propriétés et contraintes d’un domaine. Un knowledge graph est une instance de ce modèle, peuplée de données réelles. L’ontologie est le schéma ; le knowledge graph en est le contenu. En pratique, un knowledge graph robuste est toujours adossé à une ontologie formelle.

Cela dépend de la profondeur et du domaine. Une ontologie de domaine restreint (50-200 concepts) peut être construite en quelques semaines de travail collaboratif avec les experts métier. Une ontologie institutionnelle large (plusieurs milliers de concepts, comme celle de l’ANSM) est un projet de plusieurs mois. L’essentiel est de commencer par un périmètre délimité et d’étendre ensuite.

Vous voulez passer de la théorie à la pratique ?

Cogsonomy propose des formations sur mesure sur les ontologies et le web sémantique pour les équipes techniques comme pour les profils métier et management.